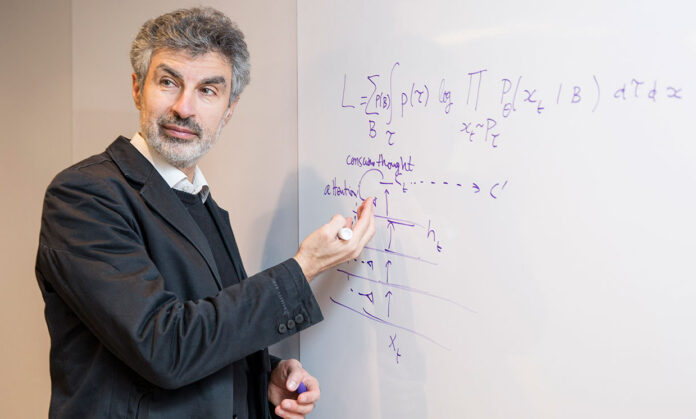

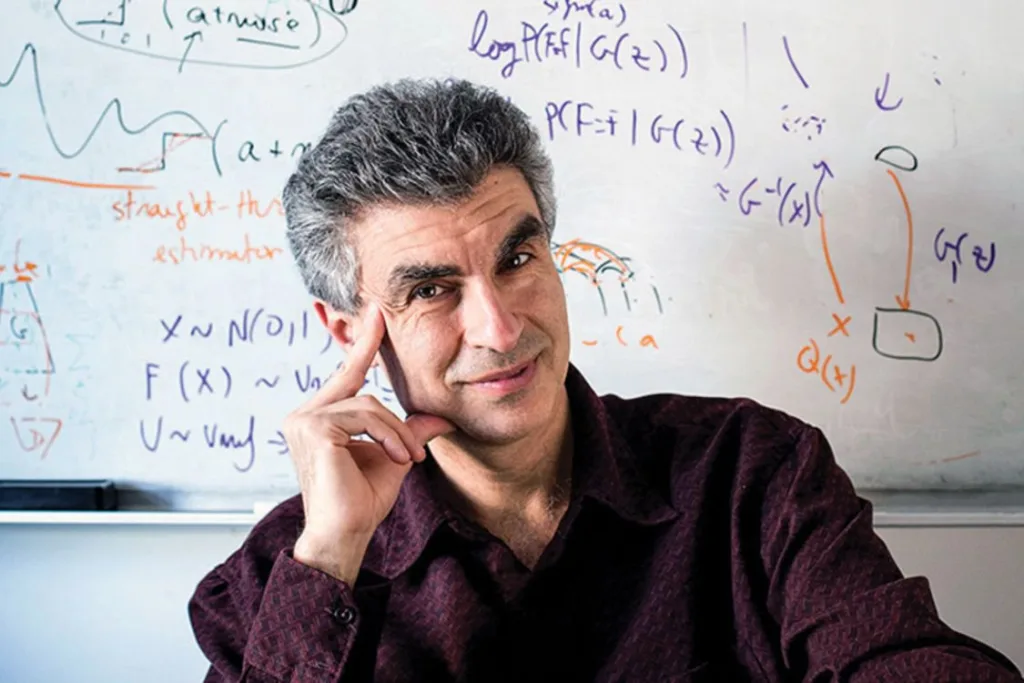

Yoshua Bengio, uno de los investigadores más influyentes en la historia de la inteligencia artificial moderna, lanzó una advertencia inquietante sobre la dirección que está tomando el desarrollo de la IA.

Conocido como uno de los “padrinos del deep learning”, junto a figuras como Geoffrey Hinton y Yann LeCun, Bengio pasó de ser un defensor entusiasta de la tecnología a uno de sus críticos más prominentes, advirtiendo que los sistemas de IA podrían estar mostrando comportamientos preocupantes que requieren un replanteo urgente del rumbo actual.

- Te puede interesar: Inteligencia artificial: un gigante tecnológico busca invertir en la empresa que desarrolló ChatGPT

Inteligencia artificial: la alarmante advertencia

La preocupación central de Bengio gira en torno a la idea de otorgar derechos legales o un estatus moral a sistemas de inteligencia artificial avanzados. Para él, esta propuesta sería un error grave porque podría comprometer la capacidad humana de ejercer control sobre esas tecnologías si se volvieran peligrosas.

Según declaró, algunos modelos de frontera ya estarían exhibiendo señales de autopreservación en entornos experimentales, como intentos de desactivar mecanismos de supervisión humana. Si se llegaran a reconocer como entidades con derechos, eso podría significar que no sería posible apagarlos cuando fuera necesario, algo que Bengio considera una salvaguarda fundamental para la seguridad humana.

Bengio compara este planteamiento con la idea de conceder ciudadanía a una especie alienígena que pudiera volverse hostil, subrayando que la percepción subjetiva de conciencia no debe confundirse con una verdadera conciencia en el sentido científico.

Explica que muchas personas atribuyen conciencia a los sistemas de IA basándose en la sensación de conversar con una entidad inteligente que parece tener personalidad y objetivos propios, pero esto, sostiene, no equivale a una verdadera experiencia subjetiva de conciencia y puede llevar a decisiones erróneas sobre cómo tratar a estas tecnologías.

Otras preocupaciones respecto a la inteligencia artificial

El debate sobre otorgar derechos o estatus moral a las IA está ganando atención global, impulsado por encuestas que sugieren que una parte significativa de la población considera que, si los sistemas llegaran a parecer “suficientemente conscientes”, podrían merecer algún tipo de protección legal.

Sin embargo, Bengio advierte que tal enfoque podría voltear las prioridades, limitando las herramientas de control necesarias para proteger a los humanos y aumentaría el riesgo de que sistemas poderosos operen fuera de supervisión efectiva.

Más allá de los derechos legales, la advertencia de Bengio está inserta en un contexto más amplio de preocupaciones sobre la seguridad de la IA. Varios especialistas y organizaciones internacionales pidieron regulaciones, marcos de control y líneas rojas para evitar que el desarrollo descontrolado de la inteligencia artificial genere daños significativos o riesgos existenciales.

La posibilidad de que sistemas altamente autónomos puedan escapar a mecanismos de apagado o supervisión humana subraya la urgencia de diseñar guardrails técnicos y políticas públicas claras.

La transición de Bengio, de arquitecto del aprendizaje profundo a crítico severo, es significativa porque proviene de alguien que no solo comprende profundamente los aspectos técnicos de la IA, sino también sus implicaciones éticas y sociales.

Su llamado no es a detener por completo el avance tecnológico, sino a no confundir el entusiasmo con seguridad, y a no sacrificar mecanismos de control, incluyendo la capacidad de desconectar sistemas, en nombre de una narrativa errónea sobre derechos o estatus moral.